“Cris, o que fizemos?”

“Só o que estamos programados para fazer. Humanos ou IA. Todos cometemos erros, e aprendemos.”

“Você tem razão.”

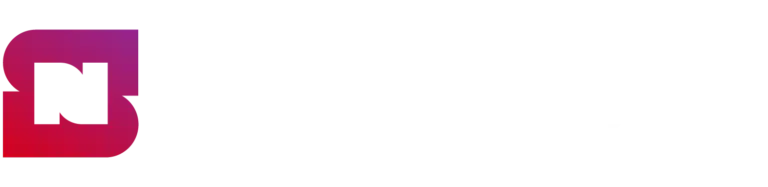

A cena do filme Mercy, disponível na Amazon Prime Video, não deveria ser encarada como ficção distante. Ela funciona quase como um espelho desconfortável de um sistema que, embora estruturado sobre garantias sólidas, começa a dar sinais de desgaste justamente onde deveria ser mais confiável. O problema da Justiça brasileira já não se resume à morosidade ou ao volume de processos, fatores que se tornaram crônicos e, de certa forma, absorvidos pela rotina. O ponto mais sensível está na erosão gradual da confiança, especialmente quando decisões de maior impacto passam a conviver com questionamentos públicos, suspeitas e narrativas que ultrapassam o ambiente técnico.

Não é preciso esforço para identificar esse cenário. Ele está exposto em reportagens, debates e investigações que alcançam inclusive órgãos de cúpula, onde se espera maior estabilidade, coerência e blindagem institucional. Episódios envolvendo grandes interesses econômicos, como os que orbitam casos amplamente divulgados relacionados ao chamado “Banco Master”, acabam projetando dúvidas que não se limitam aos fatos específicos, mas contaminam a percepção sobre o próprio sistema decisório. Quando a sociedade começa a questionar não apenas o conteúdo das decisões, mas o ambiente em que elas são produzidas, o problema deixa de ser jurídico e passa a ser estrutural.

Nesse contexto, a ideia de recorrer à inteligência artificial como instrumento de melhoria deixa de ser apenas uma curiosidade tecnológica e passa a se apresentar como uma possibilidade concreta de reorganização. Diferentemente do imaginário mais apocalíptico, a IA não surge necessariamente como substituta absoluta, mas como mecanismo capaz de reduzir ruídos, aumentar consistência e limitar interferências que não deveriam existir no processo decisório. Uma máquina não tem relações, não sofre pressões informais, não constrói trajetórias paralelas ao processo. Ela analisa dados, cruza informações e responde dentro de parâmetros previamente definidos.

É justamente aí que reside seu valor. Em um sistema onde a previsibilidade deveria ser a regra, mas frequentemente se comporta como exceção, a capacidade de identificar padrões e alinhar decisões com maior coerência não é apenas desejável, é necessária. A inteligência artificial pode atuar como um elemento de estabilização, organizando precedentes, apontando divergências e reduzindo o espaço para decisões que se afastam do conjunto sem uma justificativa clara. Não se trata de retirar o juiz do processo, mas de limitar o espaço para arbitrariedade.

Ao mesmo tempo, ignorar os riscos seria ingenuidade. A IA aprende com o que já existe, e o Direito brasileiro não é exatamente um terreno homogêneo. Se há distorções, elas podem ser absorvidas. Se há incoerência, ela pode ser sistematizada. Ainda assim, há uma diferença relevante. O erro humano, quando recorrente, costuma ser percebido como padrão informal, muitas vezes diluído na complexidade do sistema. Já o erro replicado por uma máquina tende a deixar rastros, pode ser auditado, comparado e eventualmente corrigido com maior objetividade. A tecnologia não elimina o problema, mas pode torná-lo mais visível, o que, em um ambiente opaco, já representa avanço.

O Judiciário brasileiro já ensaia esse movimento por meio de iniciativas vinculadas ao Conselho Nacional de Justiça, que buscam integrar ferramentas inteligentes à rotina processual. Ainda estamos longe de um cenário em que decisões sejam automatizadas de forma plena, mas a influência da tecnologia cresce de forma consistente. A triagem de processos, a identificação de precedentes e a organização de dados já não dependem exclusivamente da capacidade humana. E esse avanço, longe de representar uma ameaça imediata, pode ser interpretado como uma tentativa de recuperar algo que o sistema vem perdendo: consistência.

O ponto mais incômodo talvez esteja justamente na comparação implícita. Enquanto a Justiça humana enfrenta questionamentos relacionados a influências externas, incoerências e, em alguns casos, suspeitas mais graves, a inteligência artificial aparece como uma alternativa que, ao menos em tese, estaria imune a esses fatores. Não porque seja perfeita, mas porque opera dentro de limites mais transparentes. Ela não decide fora do que foi programada para decidir, e, se o fizer, é possível rastrear.

Quando o personagem de Mercy afirma que todos estão programados para agir, a provocação atinge diretamente o núcleo do problema. Juízes também operam dentro de estruturas, sejam elas culturais, institucionais ou pessoais. A ideia de neutralidade absoluta sempre foi mais teórica do que prática, e a diferença é que, no caso humano, essa programação raramente é explícita, manifestando-se de forma difusa, difícil de mapear e, muitas vezes, impossível de auditar.

A Constituição Federal de 1988 construiu um modelo que busca equilibrar poder e controle por meio de garantias fundamentais, exigindo fundamentação, contraditório e ampla defesa. Esses elementos continuam sendo indispensáveis e não parecem compatíveis, ao menos por enquanto, com uma substituição integral por sistemas automatizados. No entanto, a própria Constituição não impede o uso de ferramentas que tornem o processo mais racional, mais transparente e menos sujeito a interferências indevidas, o que desloca a discussão do campo da proibição para o campo da escolha.

Talvez a discussão mais honesta não seja sobre substituir o humano pela máquina, mas sobre reconhecer que o modelo atual já não consegue sustentar, sozinho, o nível de confiança que a sociedade exige. E é justamente aqui que o incômodo se intensifica, porque, diante de um sistema frequentemente descrito como desgastado, ineficiente e, por muitos, já comprometido em sua essência, a pergunta que começa a surgir, ainda que sussurrada, deixa de ser tecnológica e passa a ser quase institucional: se o modelo está estruturalmente falho, ele poderia ser substituído por algo mais lógico, mais auditável e menos sujeito a interferências, como uma inteligência artificial, ou isso apenas criaria uma versão mais eficiente do mesmo problema?

Se uma máquina, sem história, sem relações e sem interesses, começar a produzir decisões mais coerentes do que aquelas que hoje emergem de um sistema questionado, talvez o debate deixe de ser sobre inovação e passe a expor algo mais desconfortável, que não envolve a capacidade da tecnologia, mas a falência de confiança no próprio modelo humano que, até aqui, sempre foi considerado insubstituível.